当前的a.i可以划分为两个阶段:学习阶段和推理阶段。前者是通过对训练数据进行学习,形成经验的过程,为a.i独立解决问题做准备。后者是利用学习阶段学习到的经验解决a.i遇到的实时、变化的问题的过程。学习过程比推理过程更为复杂,对处理能力要求更高。学习部分是驱动a.i增加处理能力需求的主要因素,训练类神经网络需要对海量信息进行处理运算,学习阶段的一般做法是将训练负载切割成许多同时执行的工作任务,因此能够进行浮点运算及并行运算的处理器是学习阶段的主要需求。

学习阶段主要在数据中心完成,对处理器的运算性能要求较高。由于学习阶段是在数据中心中对海量数据进行离线处理,所以学习阶段对a.i芯片的运算性能要求较高,对芯片功耗、价格不敏感。

推理阶段多用于消费前端,更看重处理器的性能功耗比及成本。在推理阶段,神经网络只需将输入数据带入已经训练好的算法中,得到与之映射的输出结果。一般发生在应用前端,是对已经训练好的模型进行实时应用。其运算能力要求没有学习阶段强,但是要求处理器能适用前端环境。因此推理阶段更为注重的是处理器的性能功耗比和价格。

gpu性能高、功耗大、价格高,适用于学习阶段(数据中心)。gpu在并行计算、浮点以及矩阵运算方面具有强大的性能,但是其功耗较大、价格较高。但这些对于数据中心来说都不是太大问题。数据中心作为a.i深度学习高性能计算平台,快速完成对海量数据的多层次、多迭代模型分析处理才是关键。目前采用gpu加速的服务器已经可将训练速度提高5~10倍,这对于a.i研发人员来说可以加快其成果转化速度。从2011年,人工智能研究人员首次使用英伟达gpu为深度学习加速后,gpu在a.i领域发挥的巨大作用逐渐被人认识。越来越多的数据中心采用gpu加速方案来提速深度学习,gpu也开始向通用gpu方向发展。

2、gpu在a.i数据中心广泛应用

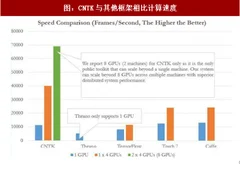

随着的不断渗透,gpu被越来越多地应用到数据中心提供深度学习并行计算加速。从2011年首次被应用到a.i,经过几年发展,gpu通用性越来越强,并行计算能力越来越高,已经将深度学习训练时间从数周缩短到几天。几乎所有互联网巨头都在依靠强大的gpu加速深度学习应用,处理复杂的算法及海量的数据,提高人工智能运行速度和执行效果。微软发布的cntk(computationalnetworktoolkit)开源深度学习神经网络工具包,就是基于英伟达gpu开发的。cntk(computationalnetworktoolkit,即计算网络工具包),是微软研究院开发的开源深度学习神经网络工具包,最多支持8个gpu并行运算。

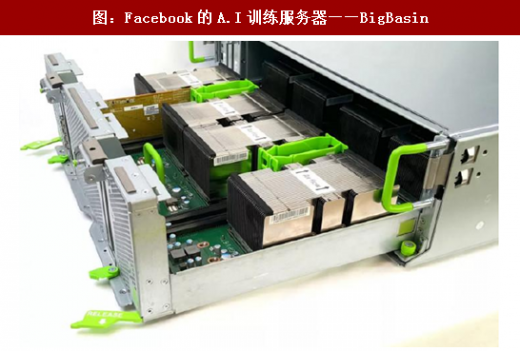

facebook于今年3月份发布的a.i训练服务器—bigbasin服务器,就是由配臵英伟达gpu的服务器搭建起来的。该服务器比之前的bigsur快了近一倍,训练规模也大了30%。该服务器可以帮助facebook进行图像、面部识别、实时翻译、理解并描述图片和视频内容,为facebook提供更多的应用以吸引用户。

图:facebook的a.i训练服务器——bigbasin

虽然一些其他芯片厂商也在研发基于fpga或者asic的a.i芯片。但不得不承认gpu广泛用于各种深度学习平台,已经成为了不可忽视的事实。

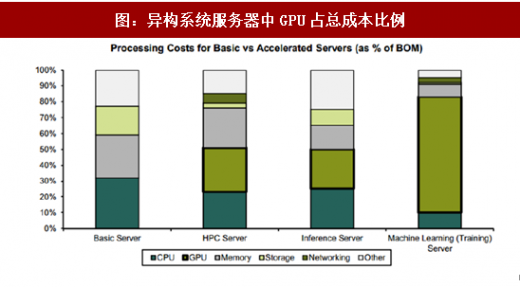

gpu cpu异构架构成为面向a.i服务器的主流架构。随着计算复杂度的逐步提升,服务器采用的处理系统并未单纯的只有gpu或gpu,而是由cpu和gpu组合而成的异构系统,两种处理器各取所长,密集的处理任务交给gpu,复杂的逻辑运算交给cpu,两种处理器协同工作,提升系统的运算速率。在a.i处理需求带动下,异构系统越来越普遍,gpu的市场需求也会进一步的扩大。bernsteinresearch统计数据表明,随着gpu cpu异构系统越来越多地应用到a.i领域,gpu价格在数据中心成本占比越来越高。

参考中国报告网发布《》

3、龙头厂商深耕a.i处理器市场

gpu的广泛使用使得传统gpu厂商受益。随着gpu在数据中心的广泛使用,gpu龙头厂商获益,数据显示,自从2011年gpu应用于人工智能领域以来,英伟达作为最有竞争力的gpu厂商,成为芯片市场的宠儿。其营业收入自2011年以来一直保持高速增长,且最近一个财年度营业收入增长了37.92%。

图形处理厂商向a.i厂商转型。gpu概念的首次提出,还是在1999年英伟达发布其geforce256图形处理芯片时。gpu的出现减轻了cpu的工作负载,减少了图形显示任务对cpu的依赖,使得计算机图形处理能力得到快速提升。公司在独立显卡领域一直占据着绝对的竞争优势。随着gpu通用计算能力被发掘,英伟达在数据中心市场获益。看到a.i广阔的应用前景后,公司也从之前的图形处理公司开始转型成a.i创业公司。

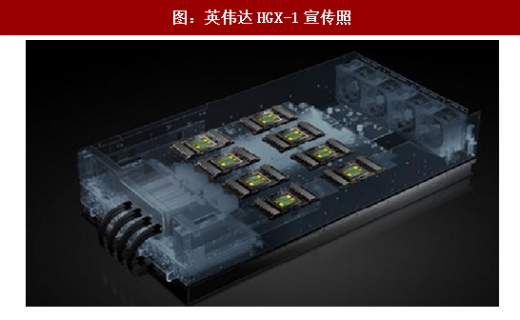

英伟达继续在a.i数据中心端、云端发力,研发各个平台的gpu加速金沙下载送彩金的解决方案。英伟达开发的nvidiadgx-1人工智能超级计算机,是世界上首台专为深度学习和人工智能加速分析而打造的系统,性能堪比250台传统服务器,将神经网络训练时间从原来的几个月缩短到了几天。除此之外,在今年5月的gtc大会上,英伟达推出了teslav100新款gpu和hgx-1云服务器。teslav100gpu研发投入高达30亿美元,是当前英伟达产品中性能最强大的加速卡,单个计算单元比上一代同架构计算卡快了12倍。hgx-1云服务器配备了8块teslav100gpu,适用于公有云、深度学习、图形渲染、cuda计算等。目前,国内外已有众多云服务商宣布将使用teslav100gpu或搭载了该产品的云服务器,国外有亚马逊aws云、微软azure云等,国内有阿里云、百度云、腾讯云等。另外,英伟达还推出了nvidiagpucloud,该产品为用户提供云端硬件和软件接口,用户可通过接口快速构建、训练和部署神经网络模型。

英伟达开始向前端推理应用领域发力。继无人驾驶计算平台—nvidiadrivepx2平台之后,英伟达近期推出了新一代深度学习应用平台tensorrt3。tensorrt3是一款可编程应用平台,训练好的神经网络可以简便的通过该平台部署到其搭载的gpu硬件上,最快只需要几秒钟,需要的人工操作也非常少。和前几代tensorrt相比,新一代平台几乎覆盖了市面上所有深度学习开源框架,支持的gpu种类也增多,能够处理的深度学习应用也更加丰富。

从英伟达推出drivepx2和tensorrt3这两个平台可以看出,英伟达正试图在人工智能的前端推理应用领域拓展其在学习训练领域的领先地位,建立自己的生态圈子。在今年9月份举行的gtcchina(gpu技术大会中国分会)上,英伟达一反常态,并没有继续介绍其在人工智能学习训练领域的辉煌战绩,推出的新品与宣布的合作案例大多集中在深度学习推理应用领域,例如,宣布与海康威视合作打造ai城市,与京东在仓储机器人与送货无人机方面进行合作。目前,英伟达的gpu已经被安防、自动驾驶等众多企业应用于终端产品进行推理计算。

我们认为目前人工智能应用领域的发展速度快于底层芯片的发展速度,gpu是目前发展最为完善的一类芯片,是现阶段人工智能应用开发的首选,英伟达凭借其gpu的先发优势在人工智能的前端推理应用领域抢占了先机。但是前端电子产品对ai芯片运算性能、价格、能耗等方面的要求相较于后端数据中心更为苛刻,手机等消费电子的竞争甚至对于芯片有极致的性能要求,gpu这样一款从图形图像处理器转型而来的ai芯片产品不能包打天下,基于fpga、asic的ai定制芯片大有可为,同样蕴藏巨大机会。

【金沙下载送彩金的版权提示】观研报告网倡导尊重与保护知识产权。未经许可,任何人不得复制、转载、或以其他方式使用本网站的内容。如发现本站文章存在金沙下载送彩金的版权问题,烦请提供金沙下载送彩金的版权疑问、身份证明、金沙下载送彩金的版权证明、金沙下载送彩金的联系方式等发邮件至kf@chinabaogao.com,我们将及时沟通与处理。